一、 核心概念术语总结

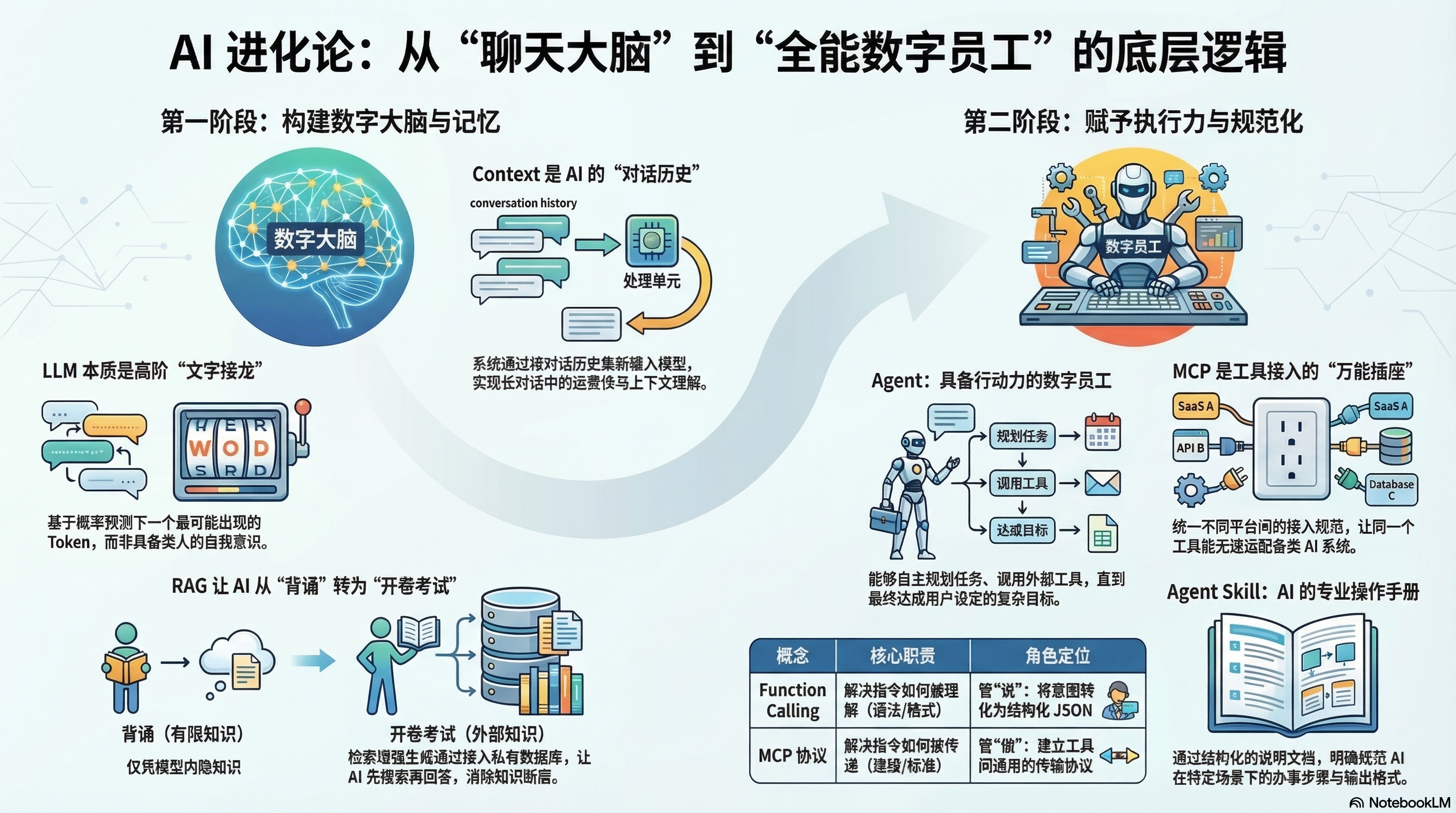

LLM: (Large Language Model) 大语言模型 基于Transformer架构训练的底层引擎,本质是一个“文字接龙游戏”,通过接收输入并基于概率预测下一个最可能出现的词(Token)来生成回答。

Tokenizer: (分词器/文本处理中间人) 连接人类文字与大模型之间的桥梁。它负责“编码”(把文字切分为Token并映射成数字 ID)和“解码”(把模型输出的数字 ID 还原成文字),因为大模型本质上只认识数字。

Token: (最小数据单元) 大模型处理文本的最基本单元。它和人类的“词”不是绝对的一对一关系(例如一个Token大约等于0.75个英文单词或1.5到2个汉字)。

Context: (上下文) 大模型每次处理任务时接收到的“信息总和”,可以看作是大模型的“临时记忆体”。它包含了用户问题、历史对话记录、系统规则(System Prompt)以及工具列表等内容。

Context Window: (上下文窗口) 代表大模型的 Context 最多能够容纳的 Token 数量上限(例如100万个 Token)。

RAG: (Retrieval-Augmented Generation) 检索增强生成 当背景资料(如千页手册)过大时,用来抽取与用户问题最匹配的几个片段发给大模型的技术。它解决了Context Window大小限制的问题,并降低了成本。

Prompt: (提示词) 给大模型的具体问题或指令。分为两类:

- User Prompt (用户提示词):用户自己在对话框输入的具体需求或问题。

- System Prompt (系统提示词):开发者在后台配置的提示词,用于定义大模型的人设和做事规则。

Tool: (工具/外部函数) 赋予大模型感知和影响外部环境能力的机制。本质上是一个函数(如天气查询接口),大模型通过平台调用它来获取自身知识库以外的实时信息。

MCP: (Model Context Protocol) 模型上下文协议 一套统一的工具接入规范标准。有了它,工具开发者只需编写一次代码,就能在所有支持 MCP 的 AI 平台上无缝接入使用。

Agent: (代理/智能体) 一个能够自主规划、自主调用外部工具、持续运作直到解决用户问题的程序系统,它拥有了类似人类的自主逻辑思考能力。

Agent Skill: (代理技能) 本质上是一份写给 Agent 看的说明文档(Markdown格式),用于明确规定 Agent 处理特定任务时的执行步骤、判断规则、输出格式以及元数据(如技能名称),避免每次交互时用户都需要重复输入长串规则。

二、 底层逻辑与运行流程图

协同工作的运作流程图

流程简述: 当您输入一段话(User Prompt),它会先被 Tokenizer 切分成 Token。这些 Token 连同开发者预设的 System Prompt、历史记录以及 RAG 检索到的内部文档片段,共同汇聚成 Context(受限于 Context Window 的大小)。LLM 接收 Context 后进行推理,如果任务复杂且需要外部信息,Agent 会根据 Agent Skill 规定的说明书,透过统一标准 MCP 去规划并调用对应的 Tool。工具执行完毕后,结果会送回模型,大模型最终梳理好逻辑,通过 Tokenizer 解码输出最终的文字结果